L’analyse de Big Data exécute une analyse et un traitement par lots sur les données stockées, telles que les données d’une couche d’entités ou de répertoires de Big Data sur le cloud comme Amazon S3 et le stockage d’objets blob Azure. Les analyses de Big Data sont généralement utilisées pour synthétiser des observations, procéder à des analyses de modèles et enrichir les données. L’analyse qui peut être effectuée utilise des outils appartenant aux catégories d’outils suivantes dans Velocity :

- Analyser la répartition spatiale

- Enrichissement de données

- Rechercher des localisations

- Gérer les données

- Synthétiser les données

- Utiliser la proximité

Exemples

- En tant que scientifique de l’environnement, vous pouvez identifier les heures et les emplacements des niveaux d’ozone élevés dans le pays dans un jeu de données de millions d’enregistrements de capteur statique.

- En tant qu’analyste commercial, vous pouvez traiter des millions d’emplacements anonymes de téléphones portables dans une plage temporelle donnée afin de déterminer le nombre de clients potentiels situés dans un rayon défini par rapport aux magasins.

- En tant qu’analyste SIG, vous pouvez exécuter une analyse de Big Data récurrente qui vérifie la présence de nouvelles entités dans une source de données toutes les cinq minutes et envoie une notification si certaines conditions attributaires ou spatiales sont remplies.

Composants d’une analyse de Big Data

Une analyse de Big Data est constituée de trois composants :

- Sources

- La source de données permet de charger des données statiques ou proches temps réel. Il existe de nombreux types de sources de données. Pour plus d’informations sur les sources et les types de sources disponibles, reportez-vous à la rubrique Qu’est-ce qu’une source de données ?.

- Une analyse peut comporter plusieurs sources de données.

- Outils

- Les outils traitent ou analysent les données chargées à partir des sources.

- Une analyse de Big Data peut comporter plusieurs outils.

- Les outils peuvent être connectés les uns aux autres lorsque la sortie d’un outil représente l’entrée de l’outil suivant.

- Sorties

- Les sorties définissent à quoi doivent servir les résultats du traitement de l’analyse de Big Data.

- De nombreuses options en sortie sont disponibles, notamment le stockage des entités dans une couche d’entités (nouvelle ou existante), l’écriture des entités sur une couche cloud dans Amazon S3 ou un stockage blob Azure, etc. Pour plus d’informations, reportez-vous aux rubriques Présentation des sorties et Principes fondamentaux des sorties analytiques.

- Le résultat d’un outil ou d’une source peut être envoyé à plusieurs sorties.

Utiliser les sorties

L’exécution d’une analyse temps réel ou d’une analyse de Big Data génère une ou plusieurs sorties. En fonction du type de sortie configuré, vous pouvez accéder à ces sorties et interagir avec elles dans l’application ArcGIS Velocity de plusieurs façons.

Sorties de couche d’entités ArcGIS et de couche de flux temps réel

Lorsqu’une analyse en temps réel ou une analyse de Big Data crée une sortie de couche d’entités ou de couche de flux en continu, vous pouvez interagir avec ces couches en sortie dans Velocity. Notez que ces méthodes ne sont pas disponibles si l’analyse n’a pas encore été exécutée.

Accéder aux sorties de couche d’entités et de couche de flux temps réel dans l’analyse

Lorsque vous mettez à jour une analyse qui a été exécutée et a correctement créé des couches en sortie, cliquez avec le bouton droit sur un nœud de couche d’entités ou de couche de flux en continu dans l’éditeur d’analyse pour afficher les options disponibles permettant notamment d’accéder aux propriétés du nœud, de modifier l’étiquette du nœud, d’afficher les détails de l’élément, d’ouvrir la couche dans une visionneuse de carte ou de scène, d’échantillonner les données du nœud, de supprimer le nœud et bien plus encore.

Accéder aux sorties de couche d’entités et de couche de flux temps réel à partir de la page Layers (Couches)

Toutes les couches d’entités, les couches d’images de carte et les couches de flux en continul créées par des analyses de Big Data ou en temps réel apparaissent dans la page Layers (Couches) de Velocity. À partir de là, vous pouvez mettre à jour des couches existantes, afficher ces couches dans une visionneuse de cartes, accéder aux détails des éléments et les afficher, ouvrir la couche dans le répertoire des services REST, mais également supprimer et partager les couches.

Sorties Amazon S3 et stockage d’objets blob Azure

Les analyses de Big Data permettent d’écrire les entités en sortie vers le stockage cloud Amazon S3 ou blob Azure. Une fois l’analyse de Big Data terminée, les données sont disponibles à l’emplacement correspondant sur le cloud. Si la sortie n’apparaît pas comme prévu, consultez les journaux d’analyse à partir de l’onglet Logs (Journaux).

Toutes les autres sorties

Les autres types en sortie pour les analyses de Big Data incluent E-mail et Kafka. Avec ces sorties, Velocity établit une connexion avec la sortie sélectionnée et envoie les données d’événement à cette sortie en conséquence.

Réaliser une analyse de Big Data (planification)

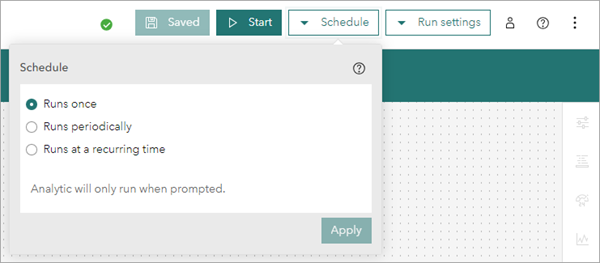

Les analyses de Big Data peuvent être configurées de sorte à être exécutées d’une manière ou d’une autre ; elles peuvent être exécutées une fois ou leur exécution peut être planifiée. Lorsque vous apportez des modifications aux paramètres d’exécution, n’oubliez pas de cliquer sur Apply (Appliquer) pour enregistrer les modifications dans l’analyse de Big Data.

Runs once (S’exécute une fois)

Les analyses de Big Data configurées de sorte à être exécutées une seule fois le sont uniquement lorsque vous démarrez l’analyse de Big Data. L’analyse procède au traitement et à l’analyse selon les paramètres définis, puis revient à un état arrêté une fois qu’elle a terminé. Ce fonctionnement est différent de celui des flux, des analyses en temps réel et des analyses de Big Data planifiées, qui continuent tous leur exécution une fois qu’elle a démarré. Runs once (S’exécute une fois) est l’option par défaut des analyses de Big Data.

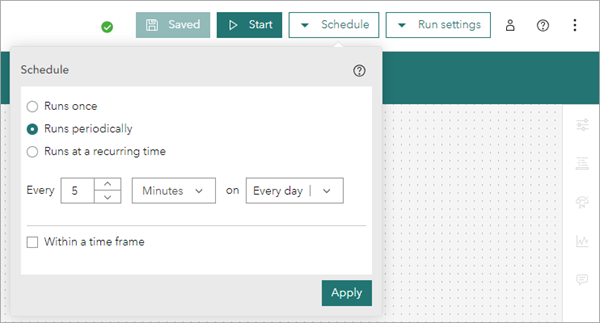

Planifié

Les analyses de Big Data peuvent être planifiées pour s’exécuter régulièrement (par exemple, toutes les cinq minutes) ou de manière récurrente (par exemple, tous les jours à 4 h).

Lorsqu’une analyse de Big Data est configurée pour s’exécuter de manière planifiée, une fois l’analyse démarrée, elle reste démarrée tant qu’elle n’est pas arrêtée. Contrairement aux analyses temps réel, les analyses de Big Data planifiées démarrées consomment des ressources uniquement pendant que l’analyse est en cours. Par exemple, si une analyse de Big Data doit s’exécuter toutes les heures et qu’elle prend quatre minutes, l’analyse de Big Data consomme uniquement des ressources une fois par heure, pendant les quatre minutes nécessaires à sa réalisation.

Pour plus d’informations sur la planification des analyses de Big Data, consultez la rubrique Programmer une analyse Big Data récurrente.

Exécuter une analyse proche temps réel

Les analyses de Big Data planifiées peuvent servir à effectuer des analyses proches temps réel dans lesquelles l’analyse de Big Data traite uniquement les dernières entités ajoutées à une couche d’entités depuis sa dernière exécution. Pour plus d’informations, des cas d’utilisation et les options de configuration des analyses proches temps réel, reportez-vous à la rubrique Exécuter une analyse proche temps réel.

Générer des produits d’informations actualisés

Les analyses de Big Data peuvent également être utilisées pour générer des produits d’informations actualisés selon un intervalle défini par l’utilisateur. Pour plus d’informations et des exemples de cas d’utilisation et d’options pour ces processus, reportez-vous à la rubrique Générer des produits d’informations actualisés.

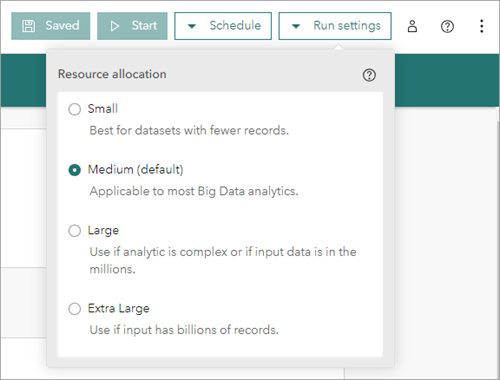

Paramètres d’exécution

Les analyses de Big Data vous permettent d’ajuster les Run settings (Paramètres d’exécution). Ces paramètres contrôlent l’allocation des ressources fournie par votre déploiement Velocity à votre analyse pour traitement. N’oubliez pas d’enregistrer votre analyse après avoir modifié des paramètres d’exécution.

En règle générale, plus vous fournissez de ressources à une analyse, plus le traitement et la génération de vos résultats sont rapides. Si vous utilisez des jeux de données plus volumineux ou une analyse complexe, il est recommandé (et parfois indispensable) d’augmenter la quantité de ressources allouées disponibles pour une analyse.

À l’inverse, si vous disposez d’une analyse simple avec peu d’entités qui est exécutée sans souci avec le plan Medium (default) (Moyen (par défaut)), envisagez de diminuer l’allocation des ressources dans les paramètres d’exécution en sélectionnant le paramètre Small (Petit). Cela vous permet d’exécuter davantage de flux, d’analyses en temps réel et d’analyses de Big Data dans votre déploiement Velocity.

Considérations et limitations

Vous devez prendre en compte certains points lorsque vous utilisez les analyses de Big Data :

- Les analyses de Big Data sont optimisées pour fonctionner avec d’importants volumes de données et pour résumer les modèles et les tendances. Cela génère habituellement un ensemble réduit d’entités ou d’enregistrements en sortie par rapport au nombre d’entités en entrée.

- Les analyses de Big Data ne sont pas optimisées pour le chargement et l’écriture d’importants volumes d’entités en une exécution unique. Si vous écrivez des dizaines de millions d’entités ou plus avec une analyse de Big Data, les temps d’exécution peuvent être plus longs.

- Il est recommandé d’utiliser les analyses de Big Data pour la récapitulation et l’analyse, plutôt que la copie des données.

- Le paramètre d’exécution Large (Grand), disponible avec les licences Standard et Advanced de ArcGIS Velocity, peut être utilisé uniquement avec un paramètre Runs once (S’exécute une fois).

Vous avez un commentaire à formuler concernant cette rubrique ?