ArcGIS AllSource の画像および点群向けのディープ ラーニング機能は、いくつかのツールおよび機能で使用できます。

モデル トレーニング

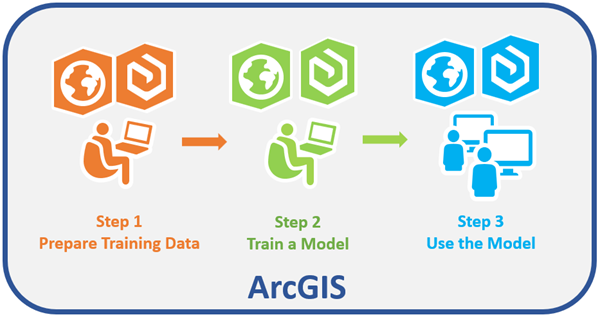

ディープ ラーニング モデルを使用して画像、点群、またはその他のデータセット内のフィーチャやオブジェクトを識別するには、まず、それらのオブジェクトを認識するようトレーニングを行う必要があります。 ディープ ラーニング モデルのトレーニングでは、従来の機械学習の分類モデルのトレーニングと同じステップを数多く実施します。 トレーニング サンプルおよび入力データを収集して提供したうえでモデルをトレーニングし、それらのフィーチャやオブジェクトを認識できるよう学習させます。

トレーニング データの準備

[ディープ ラーニングのオブジェクトのラベル付け] ウィンドウを使用すると、画像ワークフローのディープ ラーニング モデルのトレーニングに使用されるラベル付き画像データセットの収集と生成を行えます。 画像内でオブジェクトの識別やラベル付けを対話的に行い、モデルのトレーニングに必要な画像チップ、ラベル、統計情報としてトレーニング データをエクスポートします。 ラベル付きのベクター データやラスター データがすでにある場合は、[ディープ ラーニング用のトレーニング データをエクスポート (Export Training Data For Deep Learning)] ツールを使用して、次のステップに必要なトレーニング データを生成します。

[点群トレーニング データの準備 (Prepare Point Cloud Training Data)] ツールは、点群の分類向けに畳み込みニューラル ネットワークをトレーニングおよび整合チェックするためのデータを作成します。 このツールは、点群のトレーニングに使用される、圧縮されていない HDF5 ファイルの重複するブロックを多数作成します。 点群データの準備およびトレーニングの詳細については、「点群の分類に向けたディープ ラーニング モデルのトレーニング」をご参照ください。

モデルの準備およびトレーニング

[ディープ ラーニング モデルのトレーニング (Train Deep Learning Model)] ツールは、準備されたトレーニング データを使用して、画像ワークフロー向けのディープ ラーニング モデルをトレーニングします。 トレーニング プロセスの構成には、さまざまなモデル タイプと引数を使用できます。

[点群分類モデルをトレーニングを実行 (Train Point Cloud Classification Model)] ツールは、点群の分類に向けたディープ ラーニング モデルをトレーニングします。 点群データの準備およびトレーニングの詳細については、「点群の分類に向けたディープ ラーニング モデルのトレーニング」をご参照ください。

モデル推論

モデル推論とは、トレーニング済みのモデルを使用して、画像または点群から情報を抽出するプロセスを指します。 ArcGIS AllSource のモデル推論のオプションは次のとおりです。

- オブジェクトの検出 - 画像内でオブジェクトまたはフィーチャ周辺に境界四角形を生成し、その位置を特定します。 [ディープ ラーニングを使用したオブジェクトの検出 (Detect Objects Using Deep Learning)] ツールを使用します。

- オブジェクトの分類 - 画像内のフィーチャのクラスやカテゴリを識別するためのラベルを生成します。 [ディープ ラーニングを使用したオブジェクトの分類 (Classify Objects Using Deep Learning)] ツールを使用します。

- ピクセルの分類 - 各ピクセルがクラスまたはカテゴリに属する、分類済みラスターを生成します。 [ディープ ラーニングを使用したピクセルの分類 (Classify Pixels Using Deep Learning)] ツールを使用します。

- ポイント クラウドの作成 - ポイントが特定の分類コードに分類されている分類済みの点群を生成します。 [トレーニング済みモデルを使用して点群を分類 (Classify Point Cloud Using Trained Model)] ツールを使用します。 詳細については、「ディープ ラーニングを使用した点群の分類」をご参照ください。

探索的解析

[オブジェクトの検出] 探索的解析ツールでは、トレーニング済みのディープ ラーニング モデルを使用して、現在のマップまたはシーンに表示されているオブジェクトを認識します。 識別された各フィーチャは、マップの座標系で位置を指定したポイント フィーチャ、オブジェクトの方向と範囲を詳述する属性、およびその信頼値で表されます。 このツールは、トレーニング済みの Faster R-CNN、YOLO、SingleShotDetector (SSD)、および RetinaNet モデルであればどれでも使用でき、アクティブ ビュー内でオブジェクトをオンデマンド検出できるよう設計されています。

モデルの結果

モデルのトレーニング後および推論ツールの実行後という 2 つの段階で、ディープ ラーニング モデルのトレーニング結果を確認できます。

モデル トレーニングの結果

画像向けにディープ ラーニング モデルをトレーニングすると、[ディープ ラーニング モデルのトレーニング (Train Deep Learning Model)] ツールの出力には、model_metric.html というファイルが含まれます。 このファイルには、学習率、トレーニング ロスおよび整合チェック ロス、平均精度スコアなど、トレーニング済みのモデルに関する情報が含まれています。

点群向けにディープ ラーニング モデルをトレーニングすると、[点群分類モデルをトレーニングを実行 (Train Point Cloud Classification Model)] ツールの出力には、ツール結果ウィンドウのメッセージ セクションの結果が含まれます。 詳細なレポートには、各エポックでのトレーニング ロス、整合チェック ロス、精度が含まれ、保存されたディープ ラーニング モデルの精度、再現率、f1_score も含まれています。 このツールは、エポック当たりの各クラス コードの精度、再現率、F1 スコアを含む CSV テーブルも生成します。 トレーニング結果の確認の詳細については、「点群トレーニング結果の評価」をご参照ください。

モデル推論の結果

ディープ ラーニング モデルを使用後、結果を確認して、モデルの精度を評価します。

[属性] ウィンドウを使用し、オブジェクトベースの推論 ([ディープ ラーニングを使用したオブジェクトの分類 (Classify Objects Using Deep Learning)] ツール、[ディープ ラーニングを使用したオブジェクトの検出 (Detect Objects Using Deep Learning)] ツール)、または探索的解析 (対話型の [オブジェクトの検出] ツール) の結果を確認します。

オブジェクトの検出を実行した後、[オブジェクト検出精度の計算 (Compute Accuracy For Object Detection)] ツールを使用し、精度評価の表やレポートを生成できます。