Vous pouvez utiliser ce modèle dans l’outil Détecter des objets à l’aide d’algorithmes de Deep Learning disponible dans la boîte à outils ArcGIS Image Analyst dans ArcGIS Pro.

- Téléchargez le modèle Détection des navires (RVB) et ajoutez la couche d’imagerie dans ArcGIS Pro.

- Ajoutez une image satellite à trois bandes (d’une résolution spatiale de 30 centimètres) et zoomez sur une zone d’intérêt.

- Cliquez sur l’onglet Analysis (Analyse) et accédez à Tools (Outils).

- Dans la fenêtre Geoprocessing (Géotraitement), cliquez sur Toolboxes (Boîtes à outils) et développez Image Analyst Tools (Outils Image Analyst). Sélectionnez l’outil Détecter des objets à l’aide d’algorithmes de Deep Learning sous Deep Learning.

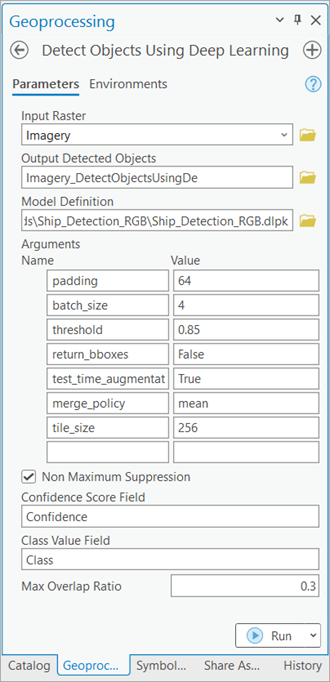

- Sous l’onglet Parameters (Paramètres), définissez les variables comme suit :

- Input Raster (Raster en entrée) - Sélectionnez l’imagerie RVB à trois bandes.

- Output Feature Class (Classe d’entités en sortie) - Définissez la couche d’entités en sortie avec des polygones représentant les navires détectés dans les images en entrée.

- Model Definition (Définition du modèle) - Sélectionnez le fichier .dlpk de modèle pré-entraîné.

- Model Arguments (Arguments du modèle) - Éventuellement, remplacez les valeurs des arguments.

- padding - Nombre de pixels en bordure des tuiles d’image à partir desquelles les prévisions sont fusionnées pour les tuiles adjacentes. Augmentez sa valeur pour lisser la sortie tout en réduisant les artefacts de bord. La valeur maximale du remplissage peut représenter la moitié de la valeur de la taille d’une tuile.

- batch_size - Nombre de tuiles d’image traitées à chaque étape de l’inférence du modèle. Ce nombre dépend de la mémoire de la carte graphique.

- threshold - Les détections dont le score de confiance est supérieur à ce seuil sont incluses dans les résultats. Les valeurs autorisées varient entre 0 et 1,0.

- return_bboxes - Définissez la valeur True (Vrai) pour retourner des emprises.

- tile_size - La largeur et la hauteur des tuiles d’image dans l’imagerie est fractionnée en vue de la prévision.

- test_time_augmentation - Procède à l’augmentation du temps de test lors de la prévision. Cette technique permet d’améliorer la robustesse et l’exactitude des prévisions du modèle. Elle implique d’appliquer des techniques d’augmentation de données lors de l’inférence. Pour ce faire, plusieurs versions légèrement modifiées des données de test doivent être générées et les prévisions doivent être agrégées. Si la valeur est vraie, les prévisions des orientations inversées et pivotées de l’image en entrée sont fusionnées dans la sortie finale et la moyenne de leurs valeurs de fiabilité est calculée. Ainsi, il est possible que la fiabilité passe en dessous du seuil pour les objets qui sont détectés dans un petit nombre d’orientations de l’image.

- merge_policy - Stratégie utilisée pour fusionner les prévisions augmentée. Les options disponibles sont mean (moyenne), max et min. Ce paramètre est seulement applicable si l’augmentation du temps de test est utilisée.

- Non Maximum Suppression (Suppression non maximale) - Vous pouvez, si vous le souhaitez, cocher la case pour supprimer les entités superposées de moindre confiance.

Si l’option est cochée, effectuez les opérations suivantes :

- Définissez Confidence Score Field (Champ de score de confiance).

- Si nécessaire, vous pouvez également définir Class Value Field (Champ de valeur de classe).

- Éventuellement, définissez Max Overlap Ratio (Ratio de superposition maximale).

- Sous l’onglet Environments (Environnements), définissez les variables comme suit :

- Processing Extent (Étendue de traitement) - Sélectionnez Current Display Extent (Étendue d’affichage actuelle) ou toute autre option dans le menu déroulant.

- Cell Size (Taille de cellule) - Définissez la valeur sur 0.3 (0,3).

La résolution de raster attendue est de 30 centimètres.

- Processor Type (Type de processeur) - Sélectionnez CPU (UC) ou GPU, le cas échéant.

Il est recommandé de sélectionner GPU, si l’option est disponible et de définir GPU ID (ID GPU) pour indiquer le GPU à utiliser.

- Cliquez sur Run (Exécuter).

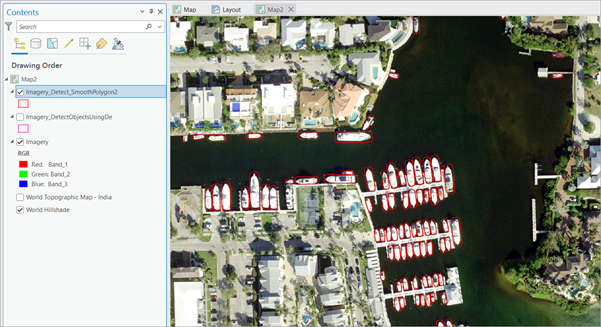

La couche en sortie est ajoutée à la carte.

- Procédez comme suit pour lisser les polygones :

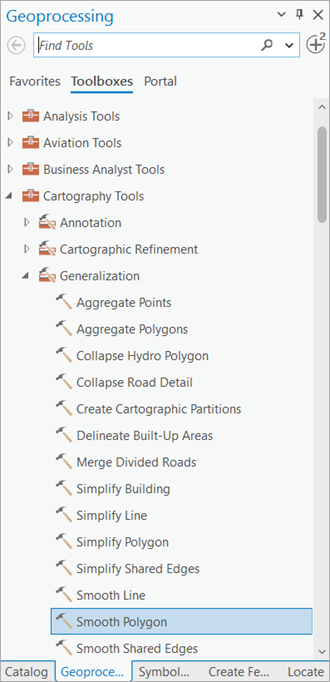

- Cliquez sur l’onglet Toolboxes (Boîtes à outils) dans la fenêtre Geoprocessing (Géotraitement), développez Cartography Tools (Outils de cartographie) et recherchez l’outil Smooth Polygon (Lisser un polygone) sous Generalization (Généralisation).

- Définissez les variables sous l’onglet Parameters (Paramètres) comme suit :

- Input Features (Entités en entrée) - Indiquez la sortie de l’outil Detect Objects Using Deep Learning (Détecter des objets à l’aide du Deep Learning) générée aux étapes précédentes comme entrée ici.

- Smoothing Tolerance (Tolérance de lissage) - Spécifiez la tolérance utilisée par l’algorithme PAEK (Polynomial Approximation with Exponential Kernel). Elle doit être supérieure à zéro. Vous pouvez choisir une unité préférée. Par défaut, l'unité de l'entité est spécifiée.

- Cliquez sur Run (Exécuter).

La couche en sortie est ajoutée à la carte.

- Cliquez sur l’onglet Toolboxes (Boîtes à outils) dans la fenêtre Geoprocessing (Géotraitement), développez Cartography Tools (Outils de cartographie) et recherchez l’outil Smooth Polygon (Lisser un polygone) sous Generalization (Généralisation).

Vous avez un commentaire à formuler concernant cette rubrique ?