Disponible avec une licence Image Analyst.

En imagerie animée, il existe une fonctionnalité qui permet de suivre spécifiquement certains objets présents dans des données vidéo pendant leur lecture. Ces objets peuvent être fixes ou mobiles, disparaître puis réapparaître ou changer de forme (comme une personne montant dans un véhicule). La fonctionnalité de suivi d’objet en imagerie animée fournit des outils automatisés et assistés par ordinateur adaptés à diverses situations observées lors du suivi des objets d’une imagerie vidéo. Elle met les technologies de Deep Learning et de vision artificielle au service du suivi d’objets, de l’extraction d’entités et de l’appariement. Ainsi, vous pouvez créer un modèle de Deep Learning pour le suivi d’objets, utiliser la suite d’outils, puis sélectionner et suivre un objet d’intérêt. Les centroïdes correspondants aux rectangles d’identification de l’objet peuvent être numérisés et enregistrés sous forme de classe de points dans la géodatabase du projet. Les points enregistrés peuvent ensuite être affichés pendant la lecture de la vidéo archivée.

Conditions requises

La fonctionnalité de suivi d’objets en imagerie animée est disponible dans ArcGIS AllSource avec l’extension ArcGIS Image Analyst.

Remarque :

Assurez-vous que vous disposez de la version la plus récente de vos pilotes de carte vidéo.

Modèle de Deep Learning

Le suivi d’objets dans une vidéo nécessite un ou plusieurs modèles de Deep Learning entraînés. L’efficacité du suivi dépend de la qualité des données d’échantillon d’entraînement pour Deep Learning et du degré de relation entre l’objet d’intérêt et les données d’entraînement. Par exemple, pour suivre un camion circulant sur une autoroute, vous devez avoir étiqueté les échantillons d’entraînement de camions sous plusieurs angles. La source des échantillons d’entraînement (images annotées) doit être une imagerie animée. Les échantillons d’entraînement étiquetés sont utilisés pour entraîner le modèle de Deep Learning à suivre des objets, en l’occurrence des camions. Le modèle donnera des résultats limités pour le suivi d’objets d’un aspect différent, comme les voitures, mais de bien meilleurs résultats pour le suivi de bus ou de véhicules de loisirs au gabarit plus important.

Vous devez installer les paquetages de structure de Deep Learning pour exécuter des processus de Deep Learning dans ArcGIS AllSource. Vous pouvez utiliser divers outils pour préparer les données d’entraînement de l’imagerie vidéo et fixe, étiqueter les objets, créer des modèles de Deep Learning, définir l’inférence et examiner les résultats. Pour savoir comment installer ces paquetages, reportez-vous à la rubrique Installer des structures de Deep Learning pour ArcGIS.

Le Deep learning sollicite beaucoup de ressources de calcul, c’est pourquoi il est recommandé de s’équiper d’un processeur graphique puissant avec prise en charge de la fonctionnalité de calcul CUDA, version 6.0 ou ultérieure.

Pour plus d’informations sur le Deep Learning et ses processus, reportez-vous aux rubriques Introduction au Deep Learning et Deep Learning dans ArcGIS Pro. Pour plus d’informations sur la suite d’outils de Deep Learning disponible dans ArcGIS, reportez-vous à la rubrique Présentation du jeu d’outils Deep Learning.

Onglet Suivi d’objets

L’onglet contextuel Object Tracking (Suivi d’objets) est activé lorsque vous sélectionnez une vidéo dans la fenêtre Contents (Contenu).

Remarque :

L’onglet Object Tracking (Suivi d’objets) est disponible une fois que les paquetages de Deep Learning sont installés et activés dans ArcGIS AllSource.Les sections ci-après présentent les outils des divers groupes de l’onglet Object Tracking (Suivi d’objets).

Groupe Objets suivis

Les outils suivants du groupe Tracked Objects (Objets suivis) permettent d’identifier et de gérer le suivi d’objets dans les données vidéo :

- Enable Tracking (Activer le suivi) - Activez le suivi d’objets à l’aide de la configuration de suivi d’objets spécifiée.

- Add Object (Ajouter un objet) - Ajoutez un objet pour procéder au suivi d’objets en cliquant sur l’objet ou en traçant interactivement un rectangle autour de lui. Double-cliquez pour activer le mode de persistance.

- Move Object (Déplacer l’objet) - Cliquez sur la trace de l’objet existant dans le Gestionnaire d’objets suivis et sélectionnez Move Object (Déplacer l’objet). Le rectangle de l’objet devient bleu et vous permet de redessiner le rectangle autour de la position mise à jour de l’objet. Double-cliquez pour activer le mode de persistance.

- Remove Object (Supprimer l’objet) - Retirez des objets suivis du lecteur vidéo en cliquant sur la trace dans le Gestionnaire d’objets suivis et sélectionnez Remove Objects (Retirer des objets). Cette action laisse la trace dans la table mais supprime le rectangle de suivi dans la vue vidéo. Double-cliquez pour activer le mode de persistance.

- Delete Objects (Supprimer des objets) - Supprimez des objets suivis du lecteur vidéo et du Gestionnaire d’objets suivis en cliquant sur les objets ou en traçant un rectangle autour d’eux. Double-cliquez pour activer le mode de persistance. Les objets suivis peuvent également être supprimés à l’aide de l’option Delete Objects (Supprimer des objets) dans la fenêtre Tracked Objects Manager (Gestionnaire d’objets suivis).

Groupe Enregistrer

Utilisez l’outil Objects to Features (Objets vers entités) du groupe Save (Enregistrer) pour enregistrer les centroïdes des objets suivis dans une géodatabase.

Groupe Gérer

Les outils suivants du groupe Manage (Gérer) permettent de gérer le suivi d’objets :

- Configure Tracker (Configurer le suivi) - Configurez le suivi d’objets et appliquez des mises à jour aux modèles de suivi d’objets par défaut.

- Tracked Objects (Objets suivis) - Affiche la fenêtre Tracked Objects Manager (Gestionnaire d’objets suivis).

Fenêtre Configurer le suivi d’objets

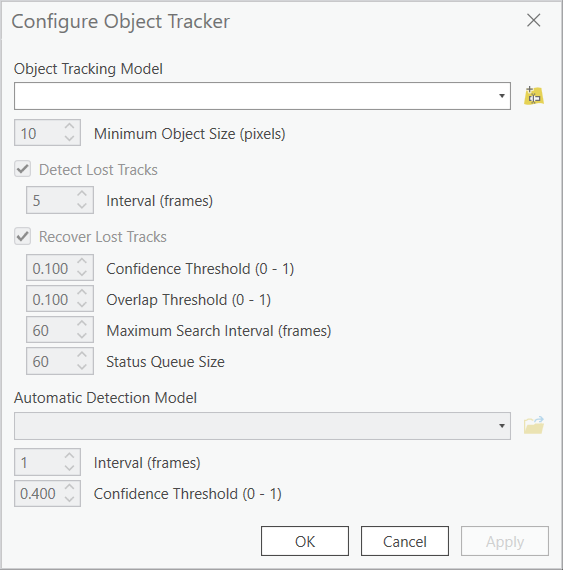

Cliquez sur le bouton Configure Tracker (Configurer le suivi) pour ouvrir la fenêtre Configure Object Tracker (Configurer le suivi d’objets). Cette fenêtre comporte les paramètres Object Tracking Model (Modèle de suivi d’objets) et Automatic Detection Model (Modèle de détection automatique).

Paramètres

Utilisez le paramètre Object Tracking Model (Modèle de suivi d’objets) pour choisir le modèle de Deep Learning et définir des paramètres supplémentaires pour le suivi d’objets.

Cliquez sur le bouton de navigation  pour ouvrir la boîte de dialogue Add Deep Learning Model From Path (Ajouter un modèle de Deep Learning à partir d’un chemin d’accès). Pour définir le chemin d’accès au fichier de paquetage du modèle de Deep Learning (.dlpk), indiquez une URL ou sélectionnez le fichier dans un répertoire local. Vous pouvez définir un alias pour le nom du modèle dans la zone de texte Model (Modèle). Cliquez sur Add (Ajouter) pour charger le modèle et fermer la boîte de dialogue. Le nom du modèle figure maintenant dans la liste déroulante Model (Modèle) et peut y être sélectionné.

pour ouvrir la boîte de dialogue Add Deep Learning Model From Path (Ajouter un modèle de Deep Learning à partir d’un chemin d’accès). Pour définir le chemin d’accès au fichier de paquetage du modèle de Deep Learning (.dlpk), indiquez une URL ou sélectionnez le fichier dans un répertoire local. Vous pouvez définir un alias pour le nom du modèle dans la zone de texte Model (Modèle). Cliquez sur Add (Ajouter) pour charger le modèle et fermer la boîte de dialogue. Le nom du modèle figure maintenant dans la liste déroulante Model (Modèle) et peut y être sélectionné.

Les paramètres proposent des options de contrôle du suivi des objets, parmi lesquelles Minimum Object Size (pixels) (Taille d’objet minimale [pixels]), Detect Lost Tracks (Détecter les traces perdues), Recover Lost Tracks (Récupérer les traces perdues) et Auto Detection Model (Modèle de détection automatique).

- Detect Lost Tracks (Détecter les traces perdues) - Indiquez si l’objet est suivi correctement sur la base de changements d’apparence, notamment un changement d’angle de vue, un masquage ou un déplacement en dehors de l’image. Cette case est cochée par défaut.

- Interval (frames) (Intervalle [images]) - Définissez la fréquence, en nombre d’images, à laquelle l’application recherche les changements d’apparence des objets. La valeur par défaut est 5.

- Recover Lost Tracks (Récupérer les traces perdues) - Indiquez, le cas échéant, toute tentative de recherche d’un objet après la perte de la trace. Cette case est cochée par défaut.

- Confidence Threshold (0-1) (Seuil de confiance [0 – 1]) - Définissez le ratio minimal entre les entités d’image sources appariées et les entités d’objets recherchées pour une restauration réussie du suivi. Le seuil de confiance est une valeur comprise entre 0 et 1. La valeur par défaut est de 0,1.

- Overlap Threshold (0-1) (Seuil de superposition [0 – 1]) - Définissez le ratio de superposition minimal entre l’objet détecté et l’objet recherché pour une restauration réussie du suivi. Le seuil est une valeur comprise entre 0 et 1. La valeur par défaut est de 0,1.

- Max Search Interval (frames) (Intervalle de recherche maximal [images]) - Définissez l’intervalle de recherche maximal, défini en unités d’images vidéo, en cas de perte d’un objet. La valeur par défaut est 60.

- Status Queue Size (Taille de la file d’attente des statuts) - Indique le nombre d’images pour lequel le statut d’un objet est conservé en cas de perte de l’objet, avant l’expiration de l’intervalle de recherche.

- Auto Detection Model (Modèle de détection automatique) - Indiquez si la détection et l’identification des objets cibles s’effectuent automatiquement à l’aide d’un modèle de détection basé sur le Deep Learning. Cette option est désactivée par défaut. Pour définir le chemin d’accès au fichier de paquetage du modèle de Deep Learning, utilisez le bouton de navigation

pour accéder au fichier dans un répertoire local et sélectionner le fichier .dlpk ou indiquez une URL.

pour accéder au fichier dans un répertoire local et sélectionner le fichier .dlpk ou indiquez une URL.- Interval (frames) (Intervalle [images]) - Définissez la fréquence, en nombre d’images, à laquelle les changements d’apparence des objets sont recherchés. La valeur par défaut est de 5 images.

- Confidence Threshold (0-1) (Seuil de confiance [0 – 1]) - Définissez le ratio minimal entre les entités d’image sources appariées et les entités d’objets recherchées pour une restauration réussie du suivi. Le seuil de confiance est une valeur comprise entre 0 et 1. La valeur par défaut est de 0,1.

Fenêtre Gestionnaire d’objets suivis

Dans l’onglet Tracked Objects (Objets suivis), vous pouvez visualiser et gérer les objets suivis. Les valeurs Status (Statut), ID et Source, décrites ci-après, de chaque objet suivi sont répertoriées dans la table.

- Status (Statut) - Statut de chaque objet suivi : activement suivi, perdu ou faisant l’objet d’une recherche.

- ID - Identifiant unique de chaque objet suivi.

- Source - Fichier vidéo source dans lequel l’objet est identifié.

La fenêtre Tracked Objects Manager (Gestionnaire d’objets suivis) interagit avec le ruban Tracked Objects (Objets suivis) lorsque l’outil Enable Tracking (Activer le suivi) est actif.

- Enable Tracking (Activer le suivi) - Activez le suivi d’objets à l’aide de la configuration de suivi d’objets spécifiée.

- Add Object (Ajouter un objet) - Ajoutez un objet pour procéder au suivi d’objets en cliquant sur l’objet ou en traçant interactivement un rectangle autour de lui. Double-cliquez pour activer le mode de persistance.

- Move Object (Déplacer l’objet) - Pour déplacer un objet existant, cliquez sur son rectangle de suivi pour le sélectionner, puis redessinez le rectangle autour de la position mise à jour de l’objet. Double-cliquez pour activer le mode de persistance.

- Remove Object (Supprimer l’objet) - Retirez des objets suivis du lecteur vidéo en cliquant sur les objets ou en traçant un rectangle autour d’eux. Double-cliquez pour activer le mode de persistance.

- Delete Objects (Supprimer des objets) - Supprimez des objets suivis du lecteur vidéo et de la fenêtre Tracked Objects Manager (Gestionnaire d’objets suivis) en cliquant sur les objets ou en traçant un rectangle autour d’eux. Double-cliquez pour activer le mode de persistance.

Suivre des objets

Pour suivre des objets, procédez comme suit :

- Dans la fenêtre Object Tracking Display (Affichage du suivi d’objets), chargez un modèle de Deep Learning et définissez les paramètres de suivi dans la fenêtre Configure Tracker (Configurer le suivi).

- Cliquez sur Enable Tracking (Activer le suivi) pour activer les outils de suivi d’objets.

- Cliquez sur Add Object (Ajouter un objet) pour tracer un rectangle autour de l’objet, ou cliquez sur l’objet à suivre dans le lecteur vidéo.

Cette étape n’est pas nécessaire lors de l’utilisation du mode Détecteur automatique.

L’objet sera suivi dans chaque image vidéo.

- Dans la fenêtre Tracked Objects Manager (Gestionnaire d’objets suivis), consultez le statut des objets suivis.

- Si l’objet est masqué et le suivi est perdu, cliquez sur Move Object (Déplacer l’objet), puis redessinez un rectangle autour de la position mise à jour de l’objet pour reprendre le suivi.

Cette étape n’est pas nécessaire lors de l’utilisation du mode Détecteur automatique.

- Vous pouvez également cliquer sur Add (Ajouter) pour ajouter un objet à suivre.

Cette étape n’est pas nécessaire lors de l’utilisation du mode Détecteur automatique.

- Vous pouvez également cliquer sur Remove (Supprimer) pour arrêter le suivi actif d’un objet.

Cette étape n’est pas nécessaire lors de l’utilisation du mode Détecteur automatique.

- Sur l’onglet Tracking (Suivi), dans le groupe Save (Enregistrer), cliquez sur Object(s) to Feature (Objet(s) vers entités), puis indiquez l’emplacement en sortie et le nom préfixé à utiliser pour stocker les centroïdes d’objet dans une classe d’entités.

Vous pouvez également préciser si la classe d’entités sera ajoutée à la carte, et indiquer la fréquence d’enregistrement des centroïdes en secondes.

Vous avez un commentaire à formuler concernant cette rubrique ?