Sie können dieses Modell im Werkzeug Objekte mit Deep Learning erkennen verwenden, das in der Toolbox "Image Analyst" in ArcGIS Pro verfügbar ist. Führen Sie die folgenden Schritte aus, um das Modell zum Erkennen von Masken verschiedener Objekte im Bild zu verwenden.

Erkennen von Objekten

Führen Sie die folgenden Schritte aus, um Masken verschiedener Objekte in Bilddaten zu erkennen:

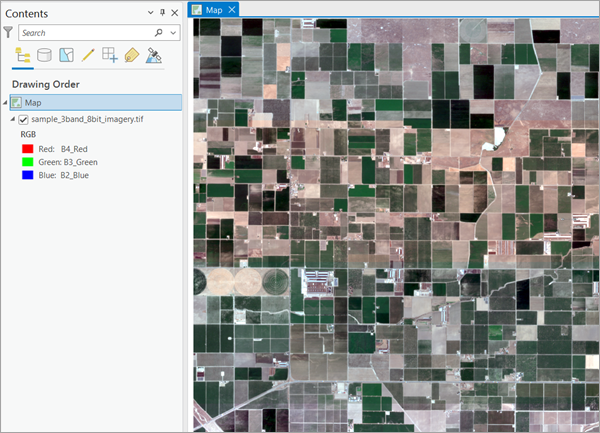

- Stellen Sie sicher, dass Sie das vortrainierte Modell Segment Anything Model (SAM) heruntergeladen und den Bilddaten-Layer in ArcGIS Pro hinzugefügt haben.

- Zoomen Sie auf einen Interessenbereich, oder verwenden Sie das gesamte Bild.

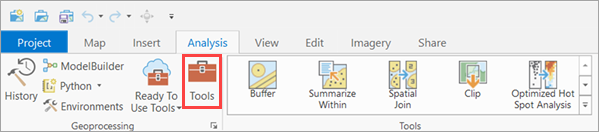

- Klicken Sie auf die Registerkarte Analyse, und navigieren Sie zu Werkzeuge.

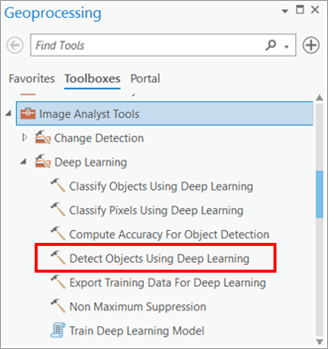

- Klicken Sie im Bereich Geoverarbeitung auf die Registerkarte Toolboxes, wählen Sie Image Analyst Tools aus, und navigieren Sie unter Deep Learning zum Werkzeug Objekte mit Deep Learning erkennen.

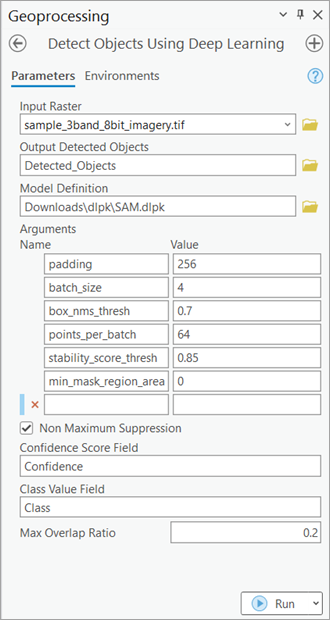

- Legen Sie die Variablen auf der Registerkarte Parameter wie folgt fest:

- Eingabe-Raster: Wählen Sie die Bilddaten aus.

- Ausgabe der erkannten Objekte: Legen Sie die Ausgabe-Feature-Class fest, die die erkannten Objekte enthalten soll.

- Modelldefinition: Wählen Sie die .dlpk-Datei des vortrainierten oder optimierten Modells aus.

- Argumente: Ändern Sie gegebenenfalls die Werte der Argumente.

- padding: Die Anzahl von Pixeln am Rahmen von Bildkacheln, aus denen Vorhersagen für benachbarte Kacheln verschmolzen werden. Erhöhen Sie den Wert, um die Ausgabe zu glätten und gleichzeitig Artefakte an den Kanten zu reduzieren. Der Maximalwert für Padding ist die Hälfte des Wertes für die Kachelgröße.

- batch_size: Die Anzahl der in den einzelnen Schritten der Modellinferenz verarbeiteten Kacheln. Dieser Wert hängt vom Speicher der Grafikkarte ab.

- box_nms_thresh: Der IoU-Grenzwert für Rahmen, der von der Funktion "Non Maximum Suppression" zum Filtern doppelter Masken verwendet wird

- points_per_batch: Legt die Anzahl der Punkte fest, die vom Modell gleichzeitig ausgeführt werden. Höhere Zahlen entsprechen einer schnelleren Ausführung, wobei aber mehr GPU-Speicher verwendet wird.

- stability_score_thresh: Erkennungen, deren Konfidenzwert höher als dieser Schwellenwert ist, sind im Ergebnis enthalten. Zulässige Werte liegen zwischen 0 und 1,0.

- min_mask_region_area: Bei einem Wert, der größer als 0 ist, wird die Nachbearbeitung angewendet, um nicht verbundene Regionen und Löcher in Masken mit Bereichen, die kleiner als "min_mask_region_area" sind, zu entfernen.

- Non Maximum Suppression: Aktivieren Sie optional das Kontrollkästchen, um die überlappenden Features mit niedrigerem Konfidenzwert zu entfernen.

Wenn Sie das Kontrollkästchen aktiviert haben, führen Sie die folgenden Schritte aus:

- Legen Sie Feld für die Konfidenzpunktzahl fest.

- Legen Sie Klassenwertefeld fest (optional).

- Legen Sie die Max. Überlappungsrate fest (optional).

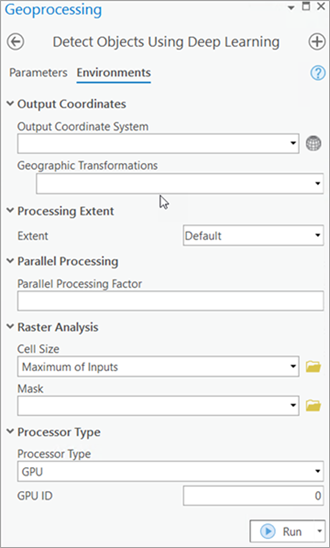

- Legen Sie die Variablen auf der Registerkarte Umgebungen fest, indem Sie für Prozessortyp die Option CPU oder GPU auswählen.

Wenn eine GPU verfügbar ist, wird empfohlen, die Option GPU auszuwählen und GPU-ID auf die zu verwendende GPU festzulegen.

- Klicken Sie auf Ausführen.

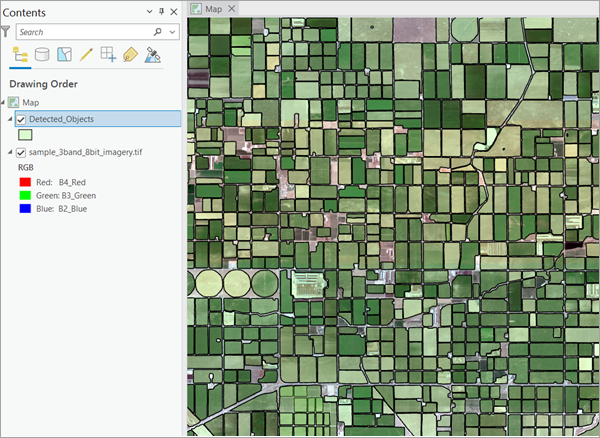

Wenn die Verarbeitung beendet ist, wird der Ausgabe-Layer der Karte hinzugefügt.