Sie können dieses Modell im Werkzeug Objekte mit Deep Learning erkennen verwenden, das in der Toolbox "Image Analyst" in ArcGIS Pro verfügbar ist. Führen Sie die folgenden Schritte aus, um das Modell zum Parsen von Text in Bildern zu verwenden.

Unterstützte Bilddaten

Dieses Modell kann mit hochauflösenden 3-Band-Bildern auf Straßenniveau mit mittlerem bis großem Text oder einem gescannten Dokument verwendet werden.

Identifizieren und Erkennen von Text

Führen Sie die folgenden Schritte aus, um Text in Bildern zu lesen:

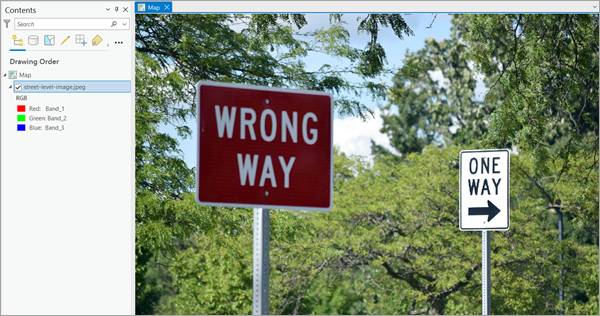

- Laden Sie das Modell Optical Character Recognition herunter, und fügen Sie in ArcGIS Pro ein Bild oder Bilddaten auf Straßenniveau mit Text hinzu.

- Zoomen Sie auf einen Interessenbereich.

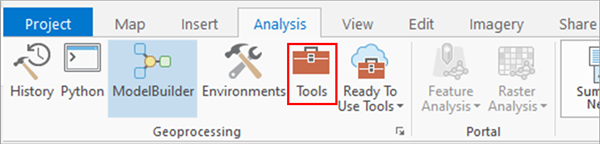

- Navigieren Sie zu Werkzeuge auf der Registerkarte Analyse.

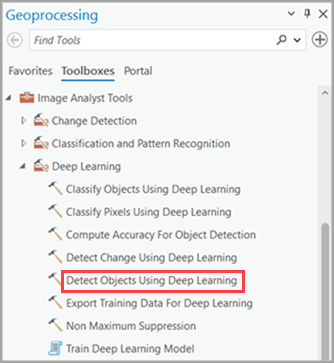

- Klicken Sie im Bereich Geoverarbeitung auf die Registerkarte Toolboxes, wählen Sie Image Analyst Tools aus, und navigieren Sie unter Deep Learning zum Werkzeug Objekte mit Deep Learning erkennen.

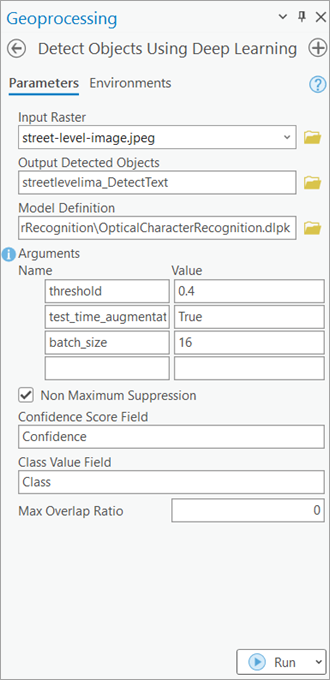

- Legen Sie die Variablen auf der Registerkarte Parameter wie folgt fest:

- Eingabe-Raster: Wählen Sie das Bild aus.

- Ausgabe der erkannten Objekte: Legen Sie die Ausgabe für erkannte Objekte fest, die die Texterkennungsergebnisse enthalten soll.

- Modelldefinition: Wählen Sie die .dlpk-Datei des vortrainierten Modells aus.

- Argumente: Ändern Sie gegebenenfalls die Werte der Argumente.

- threshold: Erkennungen, deren Konfidenzwert höher als dieser Schwellenwert ist, sind im Ergebnis enthalten. Zulässige Werte liegen zwischen 0 und 1,0.

- test_time_augmentation: Führt beim Erstellen von Vorhersagen Test-Time Augmentation durch. Wenn "True" festgelegt ist, werden Vorhersagen für gekippte und gedrehte Varianten des Eingabebilds in der endgültigen Ausgabe zusammengeführt.

- batch_size: Die Anzahl der identifizierten Texte, die gleichzeitig vom Texterkennungsmodell verarbeitet werden sollen

- Non Maximum Suppression: Aktivieren oder deaktivieren Sie optional das Kontrollkästchen nach Bedarf.

Wenn Sie das Kontrollkästchen aktiviert haben, führen Sie die folgenden Schritte aus:

- Legen Sie den Wert für Feld für die Konfidenzpunktzahl fest.

- Legen Sie den Wert für Klassenwertefeld fest.

- Legen Sie den Wert für Maximale Überlappungsrate fest.

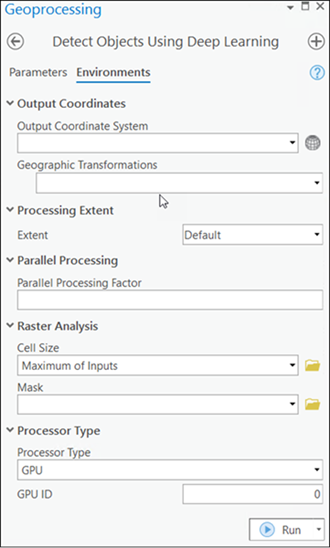

- Legen Sie die Variablen auf der Registerkarte Umgebungen wie folgt fest:

- Verarbeitungsausdehnung: Wählen Sie die Option Standard oder eine andere Option aus dem Dropdown-Menü aus.

- Prozessortyp: Wählen Sie nach Bedarf CPU oder GPU aus.

Hinweis:

Wenn eine GPU verfügbar ist, wird empfohlen, die Option GPU auszuwählen und mit GPU-ID die zu verwendende GPU anzugeben.

- Klicken Sie auf Ausführen.

Der Ausgabe-Layer wird der Karte hinzugefügt.